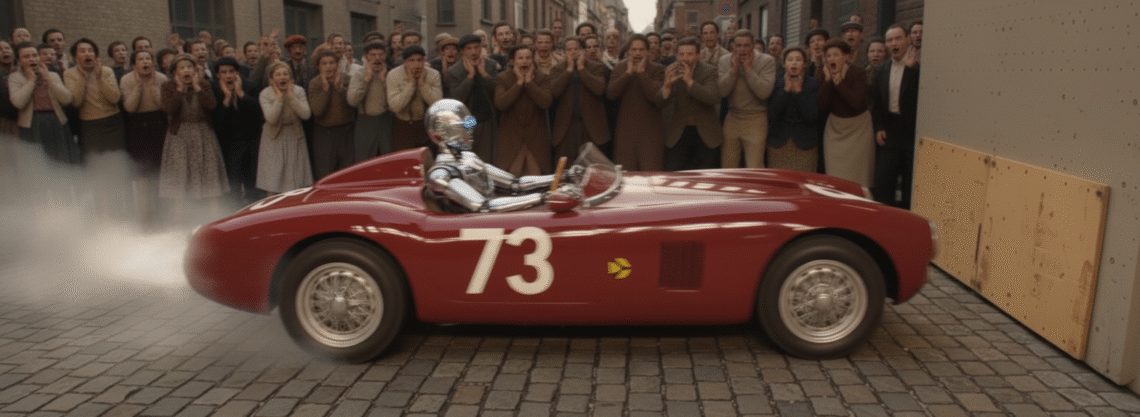

Z AI szybciej ku klęsce (produktu)

Niedawno kolega opowiedział mi jak uruchamia równolegle wiele instancji Claude Code, jak przełączając się między okienkami szybko buduje dużo „ficzerów”. Był bardzo podekscytowany tym, jak przyspiesza to rozwój jego produktu. Ale ja uważam, że to pułapka.

Podwójna pułapka.

Pułapka techniczna

Pierwszy poziom to oczywiście ogromny potencjał, że w efekcie powstanie kiepska architektura – a także dużo błędów, które będą potem cholernie trudne do znalezienia. Pomimo rosnących okien kontekstowych AI wciąż nie analizuje całej bazy kodu przy dodawaniu zmian. Nie dostaje też wizji i założeń produktu (albo też są już one poza oknem kontekstowym, czyli AI je „zapomniało”). W efekcie AI robi założenia i podejmuje decyzje w oparciu o niekompletne informacje. Metodą na zapobieżenie temu jest staranne planowanie, tworzenie przed każdą zmianą dokumentów planistycznych zawierających także ogólny kontekst produktu i celów wprowadzanej zmian. Tworzenie – i potem staranna kontrola tych dokumentów oraz poprawianie ich przez człowieka, który ma pojęcie co robi.

Podejrzewam, że bardzo niewielu z tych niesionych naprzód na skrzydłach agentów AI robi szczegółowe planowanie czy dokładnie sprawdza wygenerowany kod. Dlaczego mieliby? Cały wciągający urok tkwi w szybkości i zmniejszonym wysiłku. Jeśli wprowadzisz rygorystyczne planowanie i sprawdzanie, tracisz większość tak postrzeganej korzyści, bo zwalniasz.

Kiedy uruchamiasz równolegle wielu agentów AI takich jak Codex czy Claude Code a twój umysł szybko przełącza konteksty i twoja uwaga rozprasza się po wielu oknach to tylko pogłębiasz ten problem. Każdy agent AI robi własne założenia i decyzje. Rezultat? Baza kodu, która działa – no chyba, że przestanie działać. A wtedy powodzenia w ustaleniu dlaczego, nawet z pomocą tych samych AI, które ją zbudowały.

Pułapka biznesowa

Ale drugi poziom jest jeszcze bardziej podstępny: budowanie zbyt rozbudowanego produktu zbyt szybko, stworzenie zbyt wielu funkcji zanim uzyskasz walidację od prawdziwych użytkowników, na rynku.

A niewygodna prawda o rozwijaniu produktów jest taka: podstawowe ryzyko jest nie w tym jak coś rozwijać, ale raczej jak to sprzedać, jak dopasować się do potrzeb klientów. Większość produktów upada nie przez złe wykonanie techniczne, ale dlatego że rozwiązują problemy, których nikt faktycznie nie ma – albo rozwiązują je w sposób, za który nikt nie chce płacić. Albo świetnie robią jedno i drugie, ale ich twórcom brakuje umiejętności marketingowych i środków na reklamę.

Jednak na te problemy nie natrafisz dopóki nie spróbujesz sprzedać produktu pierwszym użytkownikom. Bardzo łatwo popaść w fascynację własnymi dziełami, tym bardziej jeśli pojawiają się szybko i niemal bez wysiłku. Tylko w efekcie masz duże szanse obudzić się pewnego dnia z technicznie imponującym produktem, którego nikt nie chce kupić.

Agenci kodujący AI dramatycznie wzmacniają to ryzyko. Usuwają naturalny hamulec, którym była „nieznośna powolność programowania”. Kiedy kodowanie było trudne i czasochłonne trzeba było walidować pomysły zanim zainwestuje się w nie miesiące pracy. Teraz można zbudować całe funkcje w dni. Brzmi jak postęp, ale oznacza to też, że można zajść bardzo daleko w złym kierunku bardzo szybko – przy okazji budując konkretny dług techniczny.

Problem nie tkwi w samych agentach kodujących AI. Claude Code czy Codex są narzędziami i jak każde narzędzie, można ich używać dobrze lub źle. Problem tkwi w przekonaniu, że więcej funkcji szybciej równa się lepszy produkt.

Nie równa się. I nigdy się nie równało.